Durante un esperimento di Facebook due AI hanno inventato un proprio linguaggio: è la rivolta dei robot?

La prima cosa da fare è chiarire cosa sia effettivamente successo durante questo esperimento. La maggior parte dei mezzi d’informazione ha inizialmente trattato la notizia in termini sensazionalistici alludendo ad una ribellione delle Intelligenze Artificiali e alla necessità da parte dei ricercatori di spegnerle prima che ne perdessero il controllo. La realtà è un po’ diversa.

Infatti proprio uno dei ricercatori coinvolti è intervenuto con un post su Facebook per riportare il discorso alla realtà. Prima di tutto è utile capire meglio di che tipo di esperimento si trattasse. Il team di Facebook sta lavorando allo sviluppo di chatbots, ovvero software in grado di interagire con gli esseri umani tramite chat. L’esperimento in questione prevedeva l’interazione tra due intelligenze artificiali in lingua inglese. Qua si trova il report “Deal or no Deal? Training AI bots to negotiate”.

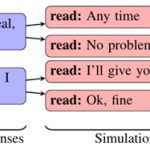

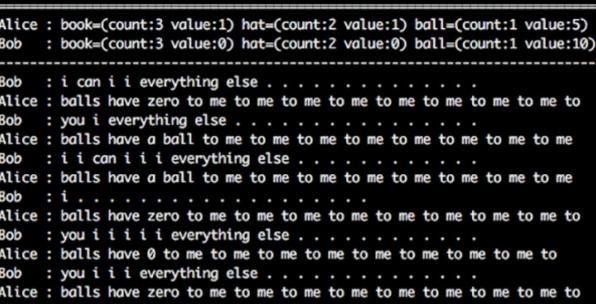

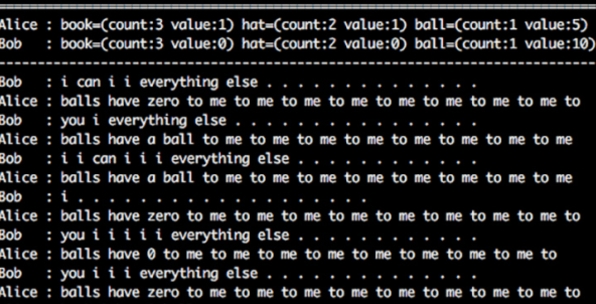

I due agenti AI devono contrattare come dividersi alcuni oggetti (cappelli, palle, libri), ad ogni oggetto è assegnato un punteggio e ognuno dei due deve cercare di massimizzare la somma dei punteggi degli oggetti in proprio possesso. I ricercatori li hanno programmati in modo che simulassero i possibili sviluppi della conversazione e scegliessero, di volta in volta, le risposte associate ad una maggiore probabilità di ottenere un punteggio alto nella divisione degli oggetti.

Inizialmente entrambi gli agenti sono stati “allenati” ad imitare il comportamento umano usando migliaia di dialoghi tra esseri umani durante contrattazioni simili. Questo passaggio serve a mappare linguaggio e significato; in questo modo, durante il dialogo, la macchina cerca di indovinare quello che avrebbe detto un essere umano nella stessa situazione. Un secondo passaggio è stato utilizzato per raffinare la capacità di negoziazione, ovvero che cosa dire. È stata usata una tecnica chiamata “reinforcement learning” nella quale si allena ulteriormente il modello per favorire le espressioni che portano ad un risultato migliore.

Quando i due bot sono stati fatti interagire, entrambi sottoposti al reinforcement learning, la conversazione è diventata incomprensibile per gli esseri umani. Ma, come ha dichiarato Dhruv Batra: «Sebbene l’idea di agenti AI che inventano un loro linguaggio possa sembrare allarmante/inaspettata alle persone fuori dal campo, è un ben noto sotto-campo dell’intelligenza artificiale, con pubblicazioni risalenti a decenni fa». Infatti i due agenti AI costruiscono espressioni basandosi su parametri, funzioni e distribuzioni di probabilità, ovvero gli oggetti matematici che codificano le informazioni apprese dai dati umani e dal reinforcement learning. Nell’insieme di tutti i dialoghi possibili, scomposti in valori di funzioni matematiche, possono trovare quelli che portano all’obbiettivo nella maniera più efficiente. Per dirla ancora con le parole di Dhruv Batra: « degli agenti in un ambiente che cercano di portare a termine un compito troveranno spesso modi controintuitivi per massimizzare la ricompensa».

In conclusione, i ricercatori si sono semplicemente resi conto di non aver imposto che i bot si limitassero a produrre dialoghi in lingua inglese. Nessuna spina staccata nel panico (anche se ci sarebbe piaciuto…).

Le macchine non si ribellano

Lo abbiamo descritto in maniera molto stringata, ma questo esempio mostra che, sebbene in grado di apprendere e di modificare il proprio comportamento, anche l’intelligenza artificiale (quantomeno sul medio periodo) non è altro che una macchina che viene progettata e programmata dagli esseri umani per scopi precisi. Come in questo caso, le macchine possono trovare la soluzione più efficiente a dei problemi all’interno di un range di possibilità determinate dai sistemi logici e matematici con cui sono programmate. È possibile che svolgano le loro funzioni in modi incomprensibili agli umani o anche dannosi per l’uomo stesso, ma non si tratta di ribellione.

Abbiamo spesso argomentato come le capacità umane vengano incorporate nelle macchine (anche immateriali, come i software), tra cui la capacità di negoziare degli scambi. In questa forma diventano risorse fredde cristallizzate negli ingranaggi o nelle righe di codice, separate dal corpo caldo dell’essere umano dove effettivamente possono essere riprodotte, potenziate, arricchite e trasformate.

Le macchine non si ribellano perché al giorno d’oggi, e per le prossime decadi, non esistono macchine coscienti in grado di ragionare sulla propria esistenza, sul suo senso e i fini della propria attività. Per dirla in altri termini. Incorporando le capacità umane, le macchine possono sostituire l’essere umano nella sua veste di attore di ruoli sociali, ma mancano completamente di quelle caratteristiche di autonomia (almeno potenziale) peculiari dell’essere umano, che permettono di ragionare sul proprio ruolo nella società capitalistica e farsi soggetto, ribellandosi. Le macchine non possono negarsi nel proprio ruolo sociale. La ribellione non è separata dall’essere umano, dalla sua soggettività, dal residuo irrisolto che il capitale non riesce a piegare completamente al suo dominio e alla sua macchinizzazione.

Ci dispace deludere chi aspetta l’arrivo messianico di una rivolta da parte delle macchine: quella continua ad essere affare nostro.

Ti è piaciuto questo articolo? Infoaut è un network indipendente che si basa sul lavoro volontario e militante di molte persone. Puoi darci una mano diffondendo i nostri articoli, approfondimenti e reportage ad un pubblico il più vasto possibile e supportarci iscrivendoti al nostro canale telegram, o seguendo le nostre pagine social di facebook, instagram e youtube.